서울대학교 공과대학은 컴퓨터공학부 김건희 교수팀이 말버릇, 추임새, 끼어들기 등 사람의 대화 행동을 인공지능(AI)이 이해하고 재현하는 음성 대화 생성 기술을 개발했다고 밝혔다.

김 교수팀은 이번 연구에서 세계 최대 규모의 대화 행동 기반 음성 데이터셋인 ‘Behavior-SD’를 구축하고, 이를 바탕으로 자연스럽게 음성 대화를 나누는 AI 모델 ‘BeDLM’을 제안했다.

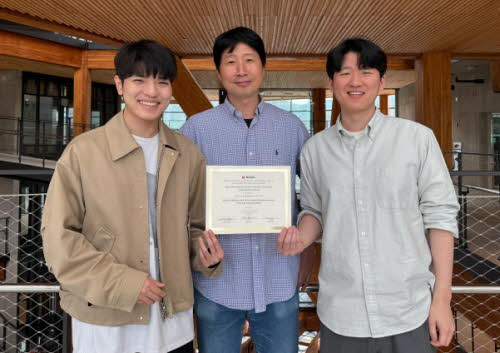

연구팀은 지난 4월 29일부터 5월 4일까지 미국 뉴멕시코주 앨버커키에서 열린 ‘NAACL 2025(북미 전산언어학회)’에서 해당 연구 논문을 구두 발표했으며, 음성 처리 및 음성 언어 이해(Speech Processing and Spoken Language Understanding) 분야에서 최고 논문상(Senior Area Chair Award)을 수상했다. NAACL은 컴퓨터가 인간의 언어를 이해, 생성할 수 있도록 해주는 AI의 한 분야인 자연어 처리(NLP) 관련 세계 최고 권위 학회 중 하나다.

연구팀은 사람들이 음성 대화를 나눌 때 텍스트 대화에서는 잘 나타나지 않는 대화 행동을 보이는 점에 주목했다. 예컨대 우리는 대화할 때 ‘음…’, ‘그니까…’ 같은 말버릇을 쓰고, 적절한 순간에 ‘맞아’, ‘응’ 같은 추임새를 넣거나 때로는 상대의 말을 끊기도 한다. 하지만 이런 미묘한 특징들을 반영하지 못한 기존 AI 대화 시스템의 말투는 부자연스럽고 기계적으로 느껴질 수밖에 없었다. 따라서 김 교수팀은 실제 사람처럼 자연스러운 대화를 나누는 AI를 구현하려면 대화 행동의 반영이 반드시 이뤄져야 한다고 봤다.

이 문제의 해결에 나선 연구팀은 말버릇과 추임새(backchannel), 끼어들기(interruption), 감정 표현 등 사람 개개인의 대화 행동을 정밀하게 반영한 음성 데이터셋과 대화 생성 기술을 함께 제시하는 성과를 거뒀다.

먼저 김 교수팀은 실제 대화 환경을 최대한 비슷하게 재현하기 위해 10만 개의 대화 패턴과 총 2000시간 분량의 음성 대화를 모아 ‘Behavior-SD (Spoken Dialogue)’ 데이터셋을 구축했다. 이 대규모의 데이터는 사람 간의 자연스러운 대화를 정밀하게 구현하도록 설계됐다. 각 화자가 주고받는 단순한 문장에 더해 세밀하게 구분된 다양한 대화 행동을 주석 처리한 방식 덕분이다.

이렇게 구축한 데이터를 바탕으로 연구팀은 행동 기반 대화 생성 모델인 ‘BeDLM (Behaviorally Aware Spoken Dialogue Generation with Large Language Models)’을 개발했다. 거대 언어 모델(Large Language Model, LLM)에 기반한 BeDLM은 대화 상황과 두 화자의 행동 패턴이 입력되면 실제 사람 간 대화에 가까운 음성 대화를 손쉽게 만들어내는 AI 기술이다. 추임새를 넣거나 말을 끊는 습관, 말버릇 등의 대화 행동을 자연스럽게 조절해 반영하기 때문에 기존 AI 대화 시스템의 한계를 극복하고 한층 더 사람다운 음성 대화를 생성할 수 있다.

BeDLM은 향후 팟캐스트 콘텐츠 제작, 상담 AI, 개인 맞춤형 음성 비서 등 사람과 AI 간의 상호작용과 정서적 반응이 필요한 여러 분야에서 널리 활용될 것으로 예상된다. 나아가 이 기술은 앞으로 상담, 교육, 돌봄 서비스 등 다양한 영역에서 사람과 AI가 더욱 원활하게 소통할 수 있도록 돕는 데에도 이용될 전망이다. 아울러 이번 연구에서 개발된 Behavior-SD 데이터셋과 코드는 모두 오픈소스로 공개돼 국내외 연구자 누구나 자유롭게 활용할 수 있다. 따라서 관련 기술의 확산과 후속 연구 또한 촉진될 것으로 기대된다.

김건희 교수는 “대화하는 사람은 보통 말하는 중에도 귀를 열고 상대방의 음성적 반응과 시각적 반응에 적응하고 맞춰가며 대화를 이끄는데, 지금까지 개발된 AI 대화 생성 모델은 이를 반영하지 못했기 때문에 그 한계를 넘고자 했다”면서 “AI가 사람처럼 자연스럽게 대화하는 기술을 한 단계 더 발전시켰다는 점에서 금번 연구의 의미가 크다”고 밝혔다.

논문의 제1저자인 이세훈 연구원은 “이번 연구는 음성 대화에서만 나타나는 다양한 행동 패턴을 데이터와 모델에 반영함으로써 한층 더 사람다운 대화를 AI로 구현하는 작업이 가능해졌다는 데 그 의의가 있다”고 밝혔다. 이어 “물론 데이터를 구축하고, AI가 사람의 대화 행동을 이해하도록 하는 모델링 방법을 찾는 과정이 쉽지 않았다”고 연구과정을 돌아보며 “BeDLM이 실제 음성 대화 서비스에 적용돼 자연스럽고 몰입감 높은 대화를 제공하는 AI 기술로 자리매김하길 기대한다”고 말했다.

서울대 컴퓨터공학부에서 박사과정을 밟고 있는 이세훈 연구원은 AI가 사람의 더 다양한 행동 패턴을 모델링하고 세밀하게 조절할 수 있도록 행동 기반 음성 대화 생성 모델의 고도화를 연구하고 있다. 앞으로 음성 기반 대화형 AI의 심화 기술을 계속 연구할 예정이며, 기업 인턴십 등 실무 경험을 통해 실제 서비스 적용과 기술 확산에도 기여할 계획이다.